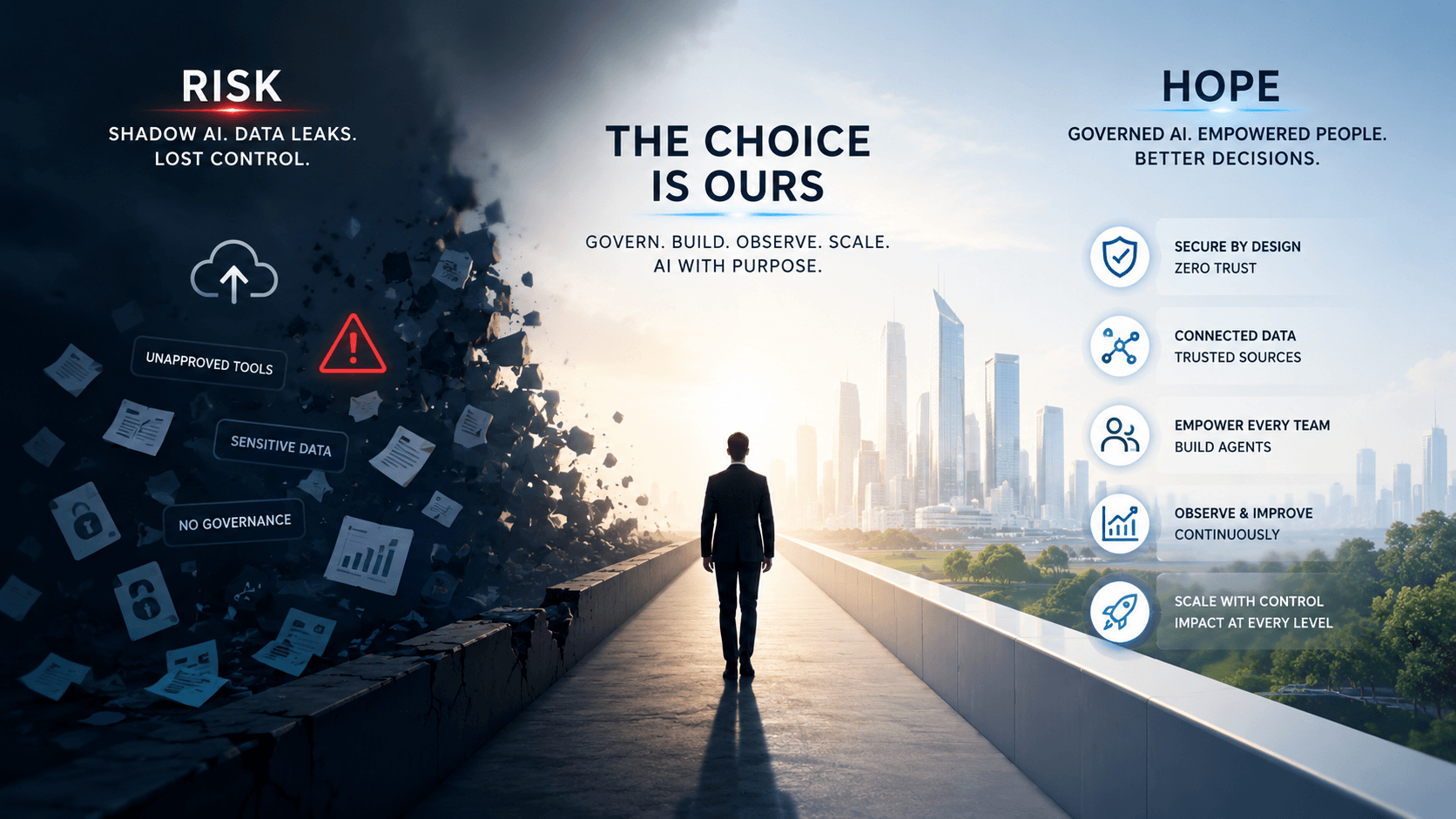

La IA en la empresa: Del riesgo y la esperanza en 2026

La IA en 2026 ya no es opcional: las empresas deben gobernarla, protegerla y convertirla en una capacidad compartida, no solo licencias.

La IA en la empresa: entre el Imperio del riesgo y la esperanza de una nueva República operativa

“I have a bad feeling about this.”

Esa frase de Star Wars resume bastante bien lo que muchos líderes deberían sentir cuando miran la forma en que sus organizaciones están “adoptando” inteligencia artificial.

Porque seamos honestos: muchas empresas creen que ya cruzaron el umbral porque compraron licencias de ChatGPT Workspace, Gemini Enterprise, Microsoft Copilot o alguna otra solución corporativa. Se sienten modernas. Se sienten en la ola. Se sienten, por fin, dentro del futuro.

Pero la verdad es más incómoda: comprar licencias no es adoptar IA. Es apenas encender un sable de luz sin saber si quien lo sostiene es un Jedi, un aprendiz o alguien que va a cortarle una mano a la organización por accidente.

Hoy, cualquier persona dentro de una empresa puede estar usando IA con permiso, sin permiso o en una zona gris. Puede estar subiendo reportes financieros a un LLM público, pegando estrategias comerciales en una herramienta de presentaciones, usando Gamma para crear una junta “bonita”, resumiendo contratos, copiando bases de datos, compartiendo precios, márgenes, gastos, credenciales, planes estratégicos o el ADN completo del negocio en plataformas que nadie en tecnología, seguridad o compliance está observando.

Y lo peor es que muchas veces esa persona no lo hace por negligencia. Lo hace porque quiere trabajar mejor. Porque tiene una reunión. Porque está cansada. Porque necesita entregar. Porque la organización le exige velocidad, pero no le ha dado un camino seguro.

Ahí está el verdadero problema: la IA ya entró a la empresa, aunque la empresa todavía no haya decidido cómo gobernarla.

Microsoft y LinkedIn reportaron en su Work Trend Index 2024 que el 75% de los trabajadores del conocimiento ya usaban IA en el trabajo, y que el uso se había casi duplicado en seis meses. También señalaron que muchos empleados estaban trayendo sus propias herramientas de IA al trabajo porque sus organizaciones no se movían con suficiente rapidez.  Reportes posteriores sobre “shadow AI” han mostrado una preocupación similar: empleados usando herramientas no aprobadas, cuentas personales y plataformas externas para procesar información sensible. Por ejemplo, TELUS Digital reportó en 2025 que el 57% de empleados empresariales que usaban GenAI admitían haber ingresado información sensible o de alto riesgo en asistentes públicos, y que cerca del 68% accedía a esos asistentes desde cuentas personales.

La pregunta entonces no es si la IA se va a usar. Ya se está usando.

La pregunta es si la empresa la va a convertir en una capacidad segura, gobernada y transversal, o si va a dejar que se convierta en una red de contrabando digital.

La falsa adopción: licencias no son transformación

Hay una confusión peligrosa en el mercado: creer que habilitar una herramienta equivale a transformar la organización.

Eso es como pensar que la Rebelión ganó porque consiguió unos X-Wings. No. Ganó porque tenía propósito, coordinación, inteligencia, entrenamiento, estrategia y una red capaz de ejecutar bajo presión.

Una empresa no adopta IA porque paga licencias. Adopta IA cuando cambia la forma en que piensa, opera, decide y mejora. La adopción real ocurre cuando la gente deja de usar IA solo para escribir más rápido y empieza a rediseñar su trabajo.

La IA no debería ser vista como una máquina para hacer correos más bonitos o presentaciones más elegantes. Ese es el nivel superficial. Útil, sí, pero insuficiente.

El verdadero salto ocurre cuando cada área empieza a preguntarse:

¿Qué tarea repetitiva hacemos todos los meses que nos roba horas?

¿Qué proceso depende de una persona que siempre tiene que “saber dónde está todo”?

¿Qué análisis hacemos tarde porque la información vive fragmentada?

¿Qué reporte se arma manualmente aunque los datos ya existen?

¿Qué decisión se toma con intuición porque nadie tiene tiempo de conectar las fuentes correctas?

Ahí empieza la adopción real. No en el prompt bonito, sino en el rediseño del trabajo.

El miedo a perder empleos y la oportunidad de elevar el pensamiento

Uno de los temores más comunes es que la IA venga a quitar trabajos. Y sí, sería ingenuo negar que habrá automatización, desplazamiento y cambios profundos en roles operativos. Pero quedarse solo en ese miedo es mirar la Estrella de la Muerte y olvidar que también existe una Alianza Rebelde.

La IA puede destruir valor si se implementa como excusa para recortar sin rediseñar. Pero también puede multiplicar valor si se usa para liberar la mente humana de tareas que nunca debieron ocupar tanto espacio.

Hay trabajos que hoy están llenos de fricción: copiar, pegar, consolidar, revisar, perseguir información, preparar reportes, buscar documentos, reconciliar datos, responder lo mismo cien veces, convertir conocimiento tácito en entregables operativos. No son tareas sin valor, pero muchas veces consumen la energía que debería estar dedicada a pensar mejor.

La esperanza está en que la IA nos obligue a subir de nivel. A pasar de operadores de procesos a diseñadores de sistemas. De ejecutores cansados a estrategas más atentos. De personas que “hacen lo que toca” a personas que preguntan: ¿cómo ajustamos mejor la tuerca?

La IA bien adoptada no reemplaza la ambición humana. La enfoca.

Tecnología no debe ser el cuello de botella

Aquí hay otro error común: creer que el departamento de tecnología debe construir todos los agentes de la organización.

Eso no escala.

Si cada área necesita automatizar tareas, crear asistentes, conectar datos, generar flujos, resumir información, analizar operaciones o responder preguntas internas, tecnología no puede convertirse en una fábrica centralizada de pequeños agentes para todos. Ese modelo muere por saturación.

El rol de tecnología debe cambiar.

Tecnología no debe ser el único constructor. Debe ser el arquitecto del entorno seguro.

Su responsabilidad debería ser:

1. Entregar fuentes de datos confiables.

No cualquier Excel perdido. No cualquier carpeta duplicada. Fuentes limpias, actualizadas, trazables y autorizadas.

2. Gobernar accesos.

Quién puede ver qué. Qué agente puede consultar qué sistema. Qué datos pueden salir. Qué acciones requieren aprobación.

3. Construir el perímetro seguro.

La IA empresarial debe operar dentro de un entorno privado, auditable y alineado con la política de seguridad.

4. Habilitar integraciones.

APIs, conectores, MCPs, servicios internos, bases de datos, documentación y sistemas operativos conectados de forma controlada.

5. Observar y auditar.

No basta con que el agente funcione. Hay que saber qué hizo, por qué lo hizo, con qué datos, bajo qué identidad y con qué resultado.

En otras palabras: tecnología no debe fabricar todos los droides. Debe construir la fábrica, las reglas, los protocolos y los límites para que los droides trabajen sin poner en riesgo la nave.

Gemini Enterprise como posible “Meca” de la IA empresarial

En este contexto, Gemini Enterprise y, especialmente, Gemini Enterprise Agent Platform aparecen como una propuesta muy relevante. No porque una herramienta por sí sola resuelva la transformación, sino porque Google está apuntando a algo que las empresas necesitan con urgencia: pasar de herramientas aisladas a una plataforma gobernada para agentes.

Google presentó Gemini Enterprise Agent Platform en abril de 2026 como una plataforma para build, scale, govern y optimize agentes empresariales. La compañía la describe como la evolución de Vertex AI, integrando capacidades de selección de modelos, construcción de modelos y agentes, más nuevas funciones de integración, DevOps, orquestación y seguridad.

Este punto es importante: la conversación ya no es solamente “qué modelo usamos”. La conversación es: cómo construimos, gobernamos, observamos y escalamos agentes que actúan dentro de la empresa.

La documentación oficial de Google Cloud posiciona Agent Platform como una plataforma para crear agentes empresariales conectados a datos internos, con componentes para construcción, escalamiento, gobierno y optimización. Incluye herramientas como Agent Development Kit, Agent Studio, RAG Engine, Vector Search, Agent Gateway, políticas de gobernanza semántica, seguridad de contenido, IAM, evaluación, observabilidad, trazas y monitoreo online.

Eso conecta directamente con la necesidad real de las empresas: no tener un chatbot más, sino un entorno donde los agentes puedan operar con datos confiables, permisos claros y supervisión.

Bain & Company resumió el cambio de manera precisa al analizar Google Cloud Next 2026: la IA empresarial se está moviendo más allá de la creación de agentes hacia la gobernanza de agentes. También destacó que identidad, contexto y seguridad están pasando a ser infraestructura central, no accesorios.

Ese es el punto crítico. En la era agentic, el riesgo no es solo que alguien pregunte algo indebido. El riesgo es que un agente pueda actuar: consultar sistemas, modificar información, enviar correos, generar documentos, tomar decisiones preliminares o activar flujos. Por eso, cada agente necesita identidad, permisos, trazabilidad y límites.

Build, Govern, Observe, Scale: el nuevo mapa de adopción

La adopción real de IA debería organizarse alrededor de cuatro verbos.

1. Build: construir desde el puesto de trabajo hacia afuera

El futuro no es que solo tecnología construya. El futuro es que cada área pueda crear herramientas propias dentro de un marco seguro.

Finanzas puede crear agentes para explicar variaciones de gastos.

Ventas puede crear asistentes para preparar propuestas con datos aprobados.

Operaciones puede automatizar reportes recurrentes.

Recursos Humanos puede responder preguntas internas sin exponer datos sensibles.

Legal puede crear flujos de revisión preliminar.

Dirección puede tener visibilidad transversal sin pedir veinte reportes manuales.

Pero “build” no significa caos. Significa empoderar con límites. Herramientas low-code, agentes preconstruidos, plantillas, conectores y datos confiables. La plataforma debe permitir que el negocio construya, pero dentro de una arquitectura diseñada por tecnología, seguridad y datos.

Como diría Yoda: “Do. Or do not. There is no try.”

No se puede “medio adoptar” IA. O se construye una capacidad organizacional, o se acumulan herramientas dispersas.

2. Govern: gobernar antes de escalar

Gobernar no es frenar. Gobernar es permitir que la IA avance sin convertir la empresa en un campo minado.

Esto incluye políticas de datos, clasificación de información, controles de acceso, auditoría, identidad para agentes, revisión de herramientas externas, catálogos de agentes aprobados, monitoreo de prompts y outputs, y reglas claras sobre qué información puede usarse en cada contexto.

Google, por ejemplo, menciona capacidades como Agent Identity, Agent Registry y Agent Gateway para que los agentes tengan identidad trazable y operen bajo guardrails empresariales.  Ese tipo de enfoque es fundamental porque el agente no debe ser una caja negra actuando con permisos heredados de cualquier usuario.

El gobierno debe responder preguntas concretas:

¿Qué agente existe?

Quién lo creó?

Qué datos usa?

Qué acciones puede ejecutar?

Qué permisos tiene?

Quién lo aprobó?

Qué logs deja?

Cómo se apaga si algo sale mal?

Sin esas respuestas, no hay adopción. Hay fe. Y en seguridad empresarial, la fe no es una política.

3. Observe: observar para aprender y corregir

Un agente no debe medirse solo por si “responde bonito”. Debe medirse por calidad, precisión, costo, latencia, utilidad, seguridad y trazabilidad.

La observabilidad es lo que permite pasar de experimento a operación. Permite ver qué hizo el agente, qué herramientas llamó, qué datos usó, dónde falló, cuándo alucinó, cuánto costó y qué impacto tuvo.

La documentación de Gemini Enterprise Agent Platform incluye capacidades como evaluación, observabilidad, trazas, topología, evaluación offline, simulación, monitoreo online y optimización de prompts.  Esto apunta a una verdad básica: los agentes empresariales no son juguetes. Son sistemas vivos que deben probarse, auditarse y mejorarse.

Un agente sin observabilidad es como volar el Halcón Milenario con los ojos cerrados. Puede que llegues. También puede que atravieses un campo de asteroides sin darte cuenta.

4. Scale: escalar sin perder control

Escalar IA no es darle acceso a todos y esperar lo mejor. Escalar es convertir casos de uso exitosos en capacidades repetibles, seguras y medibles.

Esto exige patrones: plantillas de agentes, componentes reutilizables, conectores aprobados, data sources confiables, MCPs bien diseñados, owners por agente, métricas de uso, revisión continua y entrenamiento interno.

Google describe Agent Runtime, sesiones y Memory Bank como piezas para soportar agentes de larga duración con estado y contexto persistente.  Ese tipo de capacidades abre la puerta a agentes que no solo contestan preguntas, sino que acompañan procesos completos.

Pero mientras más autonomía, más gobierno. Mientras más contexto, más responsabilidad. Mientras más integración, más necesidad de Zero Trust.

Zero Trust: no confiar ni en el entusiasmo

La IA empresarial necesita una mentalidad Zero Trust desde el inicio. No porque los empleados sean enemigos, sino porque el entusiasmo sin controles puede filtrar información crítica.

Zero Trust aplicado a IA significa que nada debería tener acceso por defecto. Ni usuarios, ni agentes, ni conectores, ni herramientas externas. Todo acceso debe estar justificado, limitado, registrado y revisado.

La empresa debe proteger su intimidad. Sus precios, gastos, contratos, estrategias, código, credenciales, procesos internos, márgenes, conocimiento acumulado y decisiones no pueden quedar desperdigados en plataformas externas porque alguien necesitaba una presentación más estética.

La paradoja es que prohibir no funciona. Si la herramienta oficial es mala, lenta o inútil, la gente usará otra. Si el camino seguro no resuelve el trabajo real, aparecerá el camino informal. La mejor defensa contra shadow AI no es solo bloquear; es ofrecer una alternativa segura que sea mejor que la alternativa riesgosa.

El cambio del 1%: la verdadera revolución

La frase final de esta visión es quizá la más importante: si una organización de 200 personas cambia 1%, cambia todo.

Porque 1% no suena heroico. No parece una revolución. No parece una escena épica con música de John Williams. Pero en la práctica, ese 1% puede significar:

Una hora menos por persona a la semana.

Un reporte mensual automatizado.

Una decisión tomada con mejores datos.

Un proceso repetitivo eliminado.

Un agente que responde preguntas internas.

Un analista que deja de copiar y empieza a interpretar.

Un área que comparte conocimiento en vez de esconderlo en carpetas.

Un equipo que mide mejor.

Un gerente que ve antes.

Una empresa que aprende más rápido.

En 200 personas, pequeños cambios se vuelven estructurales. La adopción no empieza con un gran discurso. Empieza con cien microtransformaciones que, juntas, modifican la cultura.

La IA no debe ser un lujo de los más técnicos. Debe ser una capacidad distribuida. Cada persona debería poder mirar su trabajo y preguntarse: ¿qué parte de esto puede convertirse en una herramienta? ¿Qué parte puede automatizarse? ¿Qué parte puede conectarse? ¿Qué parte puede elevarse?

Ese es el verdadero despertar de la fuerza organizacional.

Conclusión: líderes versus perdedores

La diferencia entre líderes y perdedores no será quién compró primero una licencia. Será quién entendió primero que la IA no es un software, sino una nueva forma de operar.

Los perdedores tendrán herramientas dispersas, datos filtrados, empleados improvisando, tecnología saturada, seguridad corriendo detrás del problema y líderes celebrando presentaciones bonitas sin saber qué información se entregó para crearlas.

Los líderes construirán plataformas seguras, datos gobernados, agentes observables, equipos entrenados, tecnología como habilitador, negocio como constructor y seguridad como arquitectura, no como obstáculo.

La IA no hará todo. Esa es otra fantasía peligrosa. Pero sí puede abrir espacios. Espacios para pensar mejor. Para trabajar con menos fricción. Para conectar áreas. Para reducir tareas absurdas. Para hacer visible lo que antes estaba fragmentado. Para que la empresa deje de operar como silos y empiece a comportarse como un sistema inteligente.

En Star Wars, la Fuerza no pertenece a una sola persona. Fluye, conecta, revela y transforma. En la empresa, la IA debería aspirar a algo parecido: no ser el juguete de unos pocos, sino una capacidad compartida que eleva a toda la organización.

Pero para eso hay que elegir bien.

No basta con decir que estamos en la ola.

No basta con tener Gemini, ChatGPT o cualquier otra herramienta.

No basta con felicitar al que hizo la presentación más bonita.

La pregunta real es: ¿sabemos dónde está nuestra información, quién la usa, qué agentes la procesan, qué decisiones habilita y cómo protegemos el ADN de la empresa mientras liberamos el potencial de nuestra gente?

Esa es la adopción real.

Y quizás, en medio de tanto miedo, esa sea la esperanza: que la IA no venga a reemplazar nuestra capacidad de pensar, sino a obligarnos a pensar mejor.